Bei der Suchmaschine Google handelt es sich mit einigen wenigen Ausnahmen um einen weltweiten Monopolisten. Laut Informationen von Statcounter betragen die Marktanteile der Suchmaschine in Deutschland etwa 90 Prozent (März 2022). Kein Wunder, denn die Algorithmen des US-amerikanischen Technologieriesen sind denen der Konkurrenz größtenteils überlegen. Doch selbst diese konnten Suchenden nicht weiterhelfen, wenn diese nicht in der Lage waren, ihr Begehr verständlich darzulegen. Wobei die Betonung auf „konnten“ liegt.

Google Lens Multisearch vorgestellt

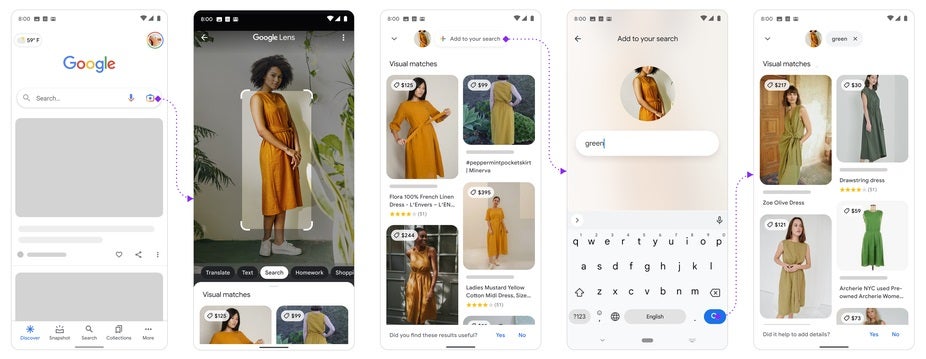

Vor Kurzem hat Google mit der Multisearch eine neue Suchart eingeführt, bei der eine exakte oder auch nur ansatzweise zutreffende Beschreibung nicht notwendig ist. Stattdessen sollen schwer zu beschreibende Objekte oder Muster schlicht mittels Google Lens abfotografiert werden. In einem zweiten Schritt wird der eigentliche Suchwunsch in Textform ergänzt. Auf der dazugehörigen Blogseite heißt es dazu: „Mit Multisearch kannst du eine Frage zu einem Objekt, das sich vor dir befindet, stellen oder deine Suche nach Farbe, Marke oder einem visuellen Attribut verfeinern.“

Google benennt dabei folgende Beispiele: Man möchte Pflegehinweise für eine bestimmte Pflanzenart heraussuchen, weiß jedoch nicht, wie diese heißt. Dann sollen ein Bild der Pflanze und der Text „Pflegehinweise“ ausreichen, um Google auf den richtigen Weg zu bringen. Noch besser geeignet ist die App für Online-Shopping. Ein bestimmtes Kleid in grüner Farbe oder ähnliche Schuhe, nur ohne Absätze? Für Google Lens Multisearch absolut kein Problem – zumindest in der Theorie.

In der Praxis hat das zum Alphabet Inc. gehörende Unternehmen gerade erst mit den Beta-Tests begonnen – also solchen, die öffentlich verfügbar sind. Im aktuellen Fall gilt dies zunächst allerdings nur für die Nutzer in den USA. Diese finden die neue Funktion in der Google-App (Android und iOS) unter „Google Lens“. Sollten die Tests erfolgreich verlaufen, dürfte Multisearch demnächst auch in den hiesigen Gefielen eingeführt werden.